Webmaster Tools – informacje o powieleniu treści

Przeglądając kilka dni temu Google Webmaster Tools natknąłem się na ciekawy wykres dotyczący indeksowania witryny. Przechodząc w menu Kondycja >> Stan indeksowania, dostajemy się do wykresu z indeksowaniem witryny. Nad wykresem widnieją butony Podstawowe i Zaawansowane.

Dane, które mnie zainteresowały dostępne na podstronie z danymi zaawansowanymi.

Zobaczymy tutaj wykres na którym możemy dowiedzieć się o:

– Zaindeksowano łącznie – czyli wszystkie znajdujące się podstrony w Google w indeksie podstawowym nie wiem jak się tu ma sprawa z SI.

– Kiedykolwiek pobrane – wszystkie pobrane podstrony – tu widać ile generuje się podstron, w niektórych serwisach,

– Niewybrane – podstrony, które są powieleniem lub są przekierowane, niestety nie ma informacji czy są to powielanie tylko wewnątrz strony czy nie.

– Zablokowane w pliku robots.txt – łatwo tu zauważyć jak się za dużo zablokuje,

– Usunięte – tu nic nie będzie jeśli nie było dla witryny prośby o usunięcie podstron z indeksu.

Z listy dostępnych informacji, zainteresowałem się informacją związana z „niewybranymi” podstronami. Dzięki dostępnej tutaj informacji, gdy zastanawiamy się dlaczego mamy problemy z indeksacją lub nie ma ruchu na nowych podstronach, można dowiedzieć się o przynajmniej jednej przyczynie. Bo problemów może być więcej…

Poniżej przedstawiam kilka przykładów stron, podejrzewam, że przedstawione informacje mogą być lekkim zaskoczeniem.

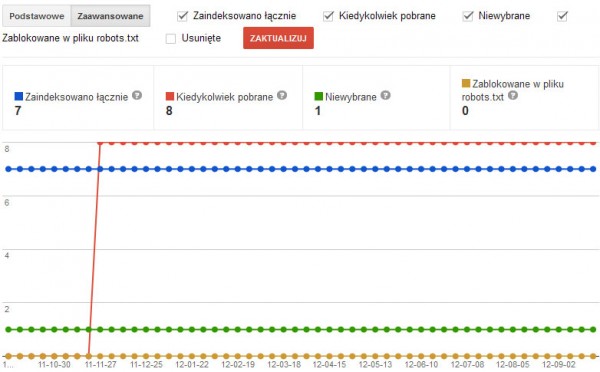

Witryna, której dotyczy wykres to mała witryna firmowa. Wraz ze stroną główną, posiada 6 podstron. Co ciekawe Google znalazło ich więcej oraz jedną powieloną. Ze względu na to, że dane są z ostatniego roku (zauważcie, że Google to wszystko pamięta, więc już prędzej to kontrolowali) powielenie nastąpiło prędzej, możliwe, że na samym początku indeksacji, gdy jeszcze w witrynie grzebał webmaster.

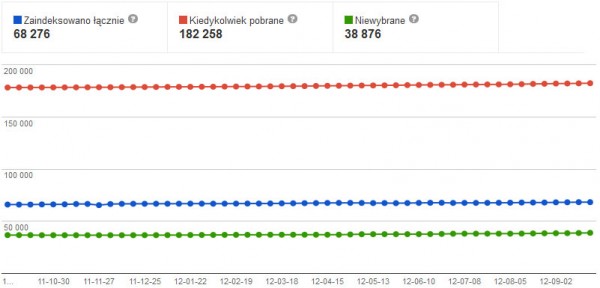

Witryna, której dotyczy ten wykres to spam stworzony z tekstów dostępnych także na innych witrynach, jak widać ilość duplikatów jest duża. Na pewno nie jest to dobre dla witryny. Ilość podstron jest na niezmienionym poziomie, dziwi mnie to bo witryna jest stale aktualizowana.

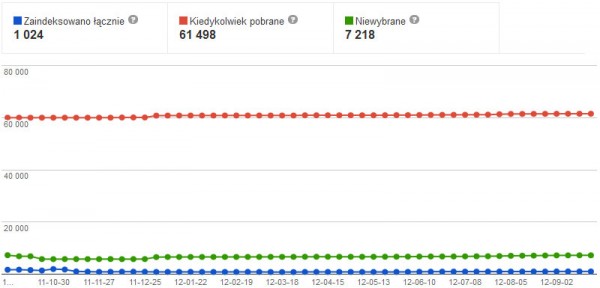

Wykres dotyczy w miarę dobrze zoptymalizowanego sklep internetowy, postawiony na Joomli. Mała liczba zindeksowanych podstron wyczerpuje prawdopodobnie ilość produktów na sklepie.

Na pierwszy rzut oka jednak widać, że należałoby się przyjrzeć duplikacji bo nie jest dobrze. Powielenia tworzy skrypt, wiele razy usuwane był powielenia strony głównej. Niestety mimo moich zaleceń skrypt nie został zmieniony. Nie przeszkadzało to w wypozycjonowaniu tej witryny na konkurencyjne frazy ogólne.

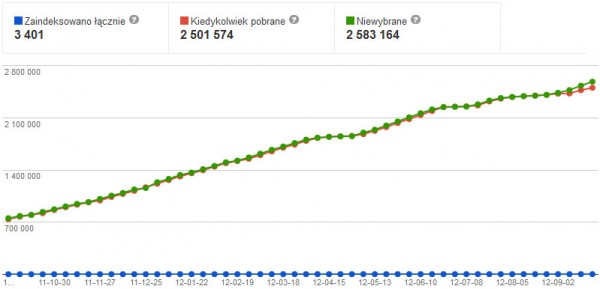

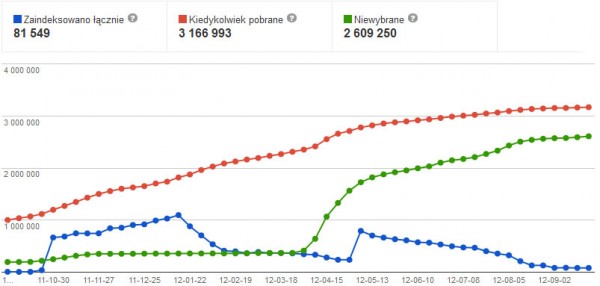

Kolejny sklep internetowy z jeszcze bardziej dziurawym skryptem. Przeglądając ten sklep znalazłem linki tworzone dynamicznie ze zmiennymi, Google radośnie sobie tymi linkami podąża, sam tworząc kolejne postronny, które są powieleniem. Efekt, jaki jest sami widzicie.

Co ciekawe, ilość niewybranych jest wyższa niż kiedykolwiek pobranych… ciekawe…

Strona rozrywkowa, z autorskim skryptem, z którym walczyłem dwa lata, pod kątem powieleń. W okolicach lutego na witrynie ktoś umieścił linki do potencji…(nie ma jak to dziury). Jak widać indeksacja spadła znacznie ale ilość niepobranych rośnie…. Jednak w tym przypadku, prawdopodobnie, w dużej mierze chodzi o przekierowania. Skrypt miał problem z paroma sprawami a programiści polubili przekierowania…

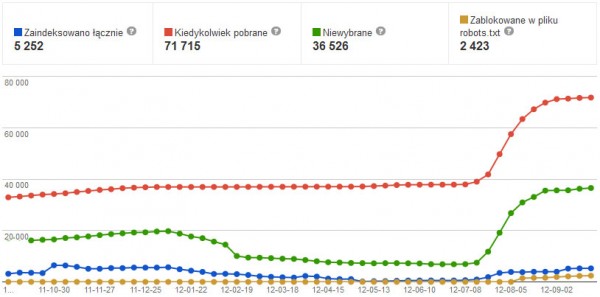

Kolejny sklep internetowy. W lipcu właściciel zmienił skrypt oraz w ramach SEO optymalizacji zastosował długie opisy produktów. Opisy są jednak do siebie bardzo podobne i wraz z tekstem w stopce powodują, że na podstronach niewiele się zmienia. Efekt – wygląda jakby Google nie lubiło tej witryny.

Na przykłady wybrałem oczywiście takie witryny, dla których W GWT widać ciekawe, moim zdaniem, dane. Nie jednak będę ukrywał tego, że każda witryna, oprócz pierwszego przykładu, ma z Google jakieś problemy.

Niestety ze względu na ilości nie byłem w stanie jednoznacznie stwierdzić, czy powielenia dotyczą powieleń wewnętrznych czy zewnętrznych. Zakładam jednak, że dane mogą dotyczyć tylko duplikacji w obrębie witryny.

A jak to u was wygląda?

komentarzy

komentarzy

Świetny wpis. Zastanawiałem się co to są te niewybrane. Tutaj mam pokazane z przykładami, więc biorę się za analizę swojej strony:P

Pozdrawiam

Przyznam że po zbadaniu swoich stron z problemami mam te same spostrzeżenia – czyli strony na dziurawych skryptach mają mnóstwo stron „niewybranych”… Rada jaką stosuję od jakiegoś czasu to nie dodaję tagów, nie tworzę podstron np z zapytań (a raczej ograniczam ich ilość do minimum) … arty daje co najmniej 2500 … przy mniejszej ilości strony stają się bardzo podobne między sobą … testy robię na stronach o kredytach.

Ciekawy tekst, tylko jak to jest z tą oceną, jeśli wartość „niewybrane” jest większa od zaindeksowano łącznie lub kiedykolwiek pobrane to wg. Ciebie mamy do czynienia już z duplikacją?

Zastanawiałem się nad tym wykresem, właściwie nad swoim wykresem, i widzę, że nie jest to dobrze, mam ponad 26 tysięcy stron zaindeksowanych,a niewybranych ponad 950 tysięcy, kiedykolwiek pobrane ponad milion sto, rozumiem czytając twój artykuł, że mam problem z duplikacją (sklep internetowy) ?

Takie podstrony wyszukiwań, tagów bardzo często nie są brane pod uwagę przez Google. Kilka lat temu było OK, teraz już różnie. Często proponuję dla takich witryn noindex.

Z powieleniem na pewno, jednak przyznam się, że trochę tego nie rozumiem, dlaczego „niewybrane” może być większe niż „kiedykolwiek pobrane”.

Zakładam, że jedna podstrona pojawia się w tych ilościach raz, także ilość „kiedykolwiek pobranych” zawsze powinna być wyższa niż „niewybranych” bo one są także w tych pobranych.

Może ktoś ma inne pomysły ?

Możesz mieć, w tej ilości są jednak także podstrony przekierowane, więc w pewnym przypadku, jakbyś przechodził z dynamicznych urli na przyjazne, wykres by rósł.

Często też powielenia powstają gdy jest zła obsługa 404 i GoogleBot dostaje HTTP200 zamiast 404.

Zaindeksowane kiedykolwiek – w Narzędziach jest błąd językowy. W języku angielskim w oryginale mamy Ever crawled (kiedykolwiek odwiedzone przez robota). Zgłosiłem to już w lipcu (wtedy te opcje sie pojawiły) do Google – jak widać nadal tego nie poprawili.

Przydatny artykuł… Teraz musze sprawdzić jak sytuacja wygląda u mnie :)

Dzięki za info, fakt, nie sprawdziłem co tam jest napisane po angielsku.

Niestety niektóre skrypty nieradzą sobię z dużym sitem, mam klienta na którego stronie pojawiło się raptem 1000 błędów 404 i strona poleciała średnio o 5 oczek w dół, ja strony nie robiłem i nie mam nawet jak tego poprawić – skrypt dziurawy jak sito i nieaktualizowany od lat, aż strach tykać…

Akuratnie miałem możliwość najpierw przeczytać zajawkę na jednym z zagranicznych blogów, potem dopiero zobaczyłem to w Narzędziach :). Od kiedy mam powiadamiania na emaila nie zaglądam tak zbyt często…

Niestety tak to już bywa, ja próbuje w takich przypadkach przekonać klienta do nowej witryny. Efekty są jednak różne.

Ja mam wiele kont, w różnych celach, więc co jakiś czas przeglądam GWT.

To teraz pytanie – ja mam wykres podobny do przykładu 4 – wynika na 90% ze składania filtrów w kategorii (sklep internetowy) – każda kombinacja filtrów to nowy URL – pytanie, czy jeśli jest dla każdej podstrony przypisywany canonical, to rozwiązuje problem, czy powinien być noindex?

Co wskazywałby canonical? W wielu przypadkach noindex na filtry wyszukiwania to najlepszy pomysł.

canonical na stronę kateogrii – przykładowo – masz kategorię z laptopami, mozesz filtrem wybrać tylko te HP i 17 cali, a canonical prowadzi do kategorii, gdzie są wszystkie.

Przykładowo – tak robi Allegro: http://allegro.pl/listing.php/showcat?id=49156&offer_type=0&price_from=400&price_to=&postcode_enabled=0&state=0&distance=1&postcode=&city=&listing_sel=2&listing_interval=7&a_text_i%5B1445%5D%5B0%5D=&a_text_i%5B1445%5D%5B1%5D=&a_text_i%5B1446%5D%5B0%5D=&a_text_i%5B1446%5D%5B1%5D=&change_view=Pokaż >

OK rozumiem, tak też jest OK.

Gugiel postanowił udostępnić nam mały procent wiedzy którą posiada, reszta danych raczej pozostanie ukryta.

Bardzo ciekawe dane… Muszę sprawdzić czy u mnie to wygląda podobnie.